La Storia del Calcolo Quantistico: Traguardi e Innovazioni – Il calcolo quantistico sta emergendo come una delle tecnologie più promettenti nel panorama scientifico e tecnologico contemporaneo. Questi computer sfruttano le peculiarità delle leggi della meccanica quantistica per risolvere problemi che sarebbero impossibili da affrontare con la tecnologia attuale.

Sebbene i macchinari attuali siano ancora lontani dal raggiungere il pieno potenziale del calcolo quantistico, il progresso in questo campo è stato straordinario dal suo inizio. In meno di cinquanta anni, il calcolo quantistico è passato dall’essere un’idea accademica a un’industria da miliardi di dollari, con molte applicazioni pratiche in vista. In questo articolo, esploreremo i dodici traguardi più significativi che hanno segnato il percorso del calcolo quantistico.

Le origini del calcolo quantistico

1980: Nascita del computer quantistico

Negli anni ’70, gli scienziati iniziarono a esplorare le possibili intersezioni tra la meccanica quantistica e la teoria dell’informazione. Fu il fisico americano Paul Benioff a formalizzare molte di queste idee, pubblicando la prima descrizione di un computer quantistico. Propose una versione quantistica della “macchina di Turing“, un modello teorico ideato dal famoso scienziato britannico Alan Turing, capace di implementare qualsiasi algoritmo. Con il suo lavoro, Benioff gettò le basi per un nuovo campo di studio.

1981: Richard Feynman e la simulazione quantistica

Nel 1981, sia Benioff che il leggendario fisico Richard Feynman presentarono conferenze sul calcolo quantistico al primo “Physics of Computation Conference”. Il discorso di Feynman, in particolare, si concentrò sull’uso dei computer per simulare fenomeni fisici. Sottolineò che, essendo il mondo fisico di natura quantistica, per simularlo esattamente erano necessari computer che operassero secondo le regole della meccanica quantistica. Introdusse il concetto di “simulatore quantistico”, una macchina che, sebbene non fosse in grado di implementare qualsiasi programma, poteva simulare fenomeni quantistici. Questa presentazione è spesso accreditata come il punto di partenza per l’interesse nel calcolo quantistico come disciplina.

Sviluppi e applicazioni pratiche

1985: Il computer quantistico universale

Un altro importante passo avanti è avvenuto nel 1985, quando David Deutsch, un professore di teoria quantistica del calcolo, propose la nozione di “computer quantistico universale”. Deutsch sostenne che il computer universale descritto da Turing, basato sulla fisica classica, non sarebbe stato in grado di simulare un computer quantistico. Riformulò quindi il lavoro di Turing utilizzando la meccanica quantistica, creando un modello capace di simulare qualsiasi processo fisico.

1994: L’algoritmo di Shor

Nonostante le promesse teoriche, ci vollero anni prima che emergessero applicazioni pratiche. Nel 1994, il matematico americano Peter Shor introdusse un algoritmo quantistico che poteva fattorizzare numeri grandi in modo efficiente.

La fattorizzazione è cruciale per molte delle attuali schemi di crittografia, e l’algoritmo di Shor ha dimostrato di risolvere questo problema in modo esponenzialmente più veloce rispetto ai computer classici, sollevando preoccupazioni riguardo alla sicurezza della crittografia moderna e spingendo allo sviluppo della crittografia post-quantistica.

1996: La ricerca non strutturata

Un altro uso promettente per i computer quantistici è emerso nel 1996, quando il ricercatore di Bell Labs Lov Grover propose un algoritmo quantistico per la ricerca non strutturata. Questo algoritmo permette di cercare informazioni in database privi di un’organizzazione ovvia, affrontando un problema comune nella scienza informatica. Grazie alla superposizione quantistica, l’algoritmo di Grover accelera significativamente il processo di ricerca, rendendolo molto più efficiente rispetto ai metodi tradizionali.

Le prime implementazioni e i traguardi commerciali

1998: Prima dimostrazione di un algoritmo quantistico

Il passaggio dalla teoria alla pratica è stato una sfida significativa. Nel 1998, un team guidato dal ricercatore IBM Isaac Chuang riuscì a implementare l’algoritmo di Grover su un computer con due qubit. Solo tre anni dopo, Chuang guidò anche la prima implementazione dell’algoritmo di Shor su hardware quantistico, riuscendo a fattorizzare il numero 15 utilizzando un processore a sette qubit.

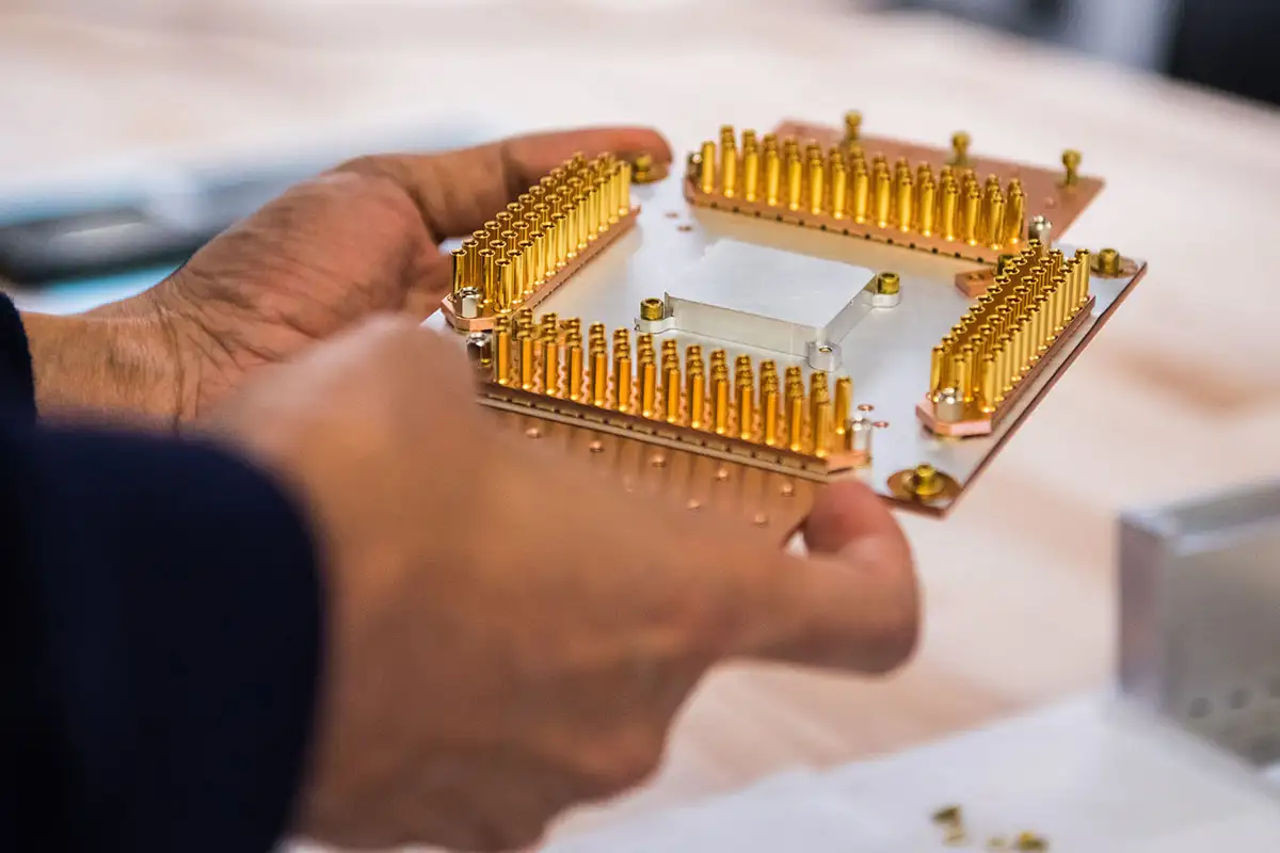

1999: Nascita del computer quantistico superconduttore

Nel 1999, i fisici della NEC, una compagnia tecnologica giapponese, scoprì che era possibile utilizzare circuiti superconduttori per creare qubit e controllarli elettronicamente. Questo approccio è diventato il metodo più popolare per il calcolo quantistico, utilizzato da molte delle principali aziende del settore, tra cui Google e IBM.

2011: Lancio del primo computer quantistico commerciale

Nonostante i progressi, il calcolo quantistico rimaneva prevalentemente un campo accademico. Il lancio del primo computer quantistico commerciale, il D-Wave One, da parte della compagnia canadese D-Wave nel maggio 2011, segnò l’inizio dell’industria del calcolo quantistico. Con 128 qubit superconduttori e un costo di circa 10 milioni di dollari, questo dispositivo utilizzava una tecnica chiamata annealing quantistico per risolvere problemi di ottimizzazione specifici.

L’era del calcolo quantistico accessibile e le sfide future

2016: Il cloud computing quantistico

Con il progredire della tecnologia, nel maggio 2016, IBM rese disponibile il suo processore a cinque qubit tramite il cloud, consentendo a chiunque di eseguire lavori di calcolo quantistico sul suo hardware. In poche settimane, oltre 17.000 persone si registraron per utilizzare il servizio, offrendo a molti la prima esperienza pratica con un computer quantistico.

2019: La supremazia quantistica di Google

Nonostante le promesse teoriche, non era stata ancora dimostrata la capacità di un processore quantistico di risolvere un problema più rapidamente di un computer classico. Nel settembre 2019, Google annunciò di aver utilizzato 53 qubit per eseguire un calcolo in 200 secondi, affermando che un supercomputer avrebbe impiegato circa 10.000 anni per completarlo. Questo evento è stato celebrato come il primo esempio di “supremazia quantistica“, ora più comunemente chiamata “vantaggio quantistico”.

2022: Sfidare la supremazia quantistica

La rivendicazione di Google fu accolta con scetticismo, in particolare da parte di IBM. Un gruppo della Chinese Academy of Sciences e altre istituzioni dimostrò che era possibile simulare le operazioni quantistiche di Google con un algoritmo classico in sole 15 ore su 512 chip GPU, evidenziando che il calcolo classico ha ancora margini di miglioramento significativi.

2023: Un record di qubit logici

Uno dei principali ostacoli per i computer quantistici odierni è l’alta probabilità di errore dell’hardware sottostante. Nel dicembre 2023, i ricercatori di Harvard, in collaborazione con la start-up QuEra, raggiunsero un traguardo significativo generando 48 qubit logici contemporaneamente, dieci volte più di quanto fosse mai stato fatto in precedenza. Questo sviluppo rappresenta un passo cruciale verso il calcolo quantistico tollerante agli errori.

In conclusione, la storia del calcolo quantistico è caratterizzata da scoperte fondamentali, sfide significative e traguardi straordinari. Con l’evoluzione della tecnologia e la crescente accessibilità dei computer quantistici, ci troviamo sull’orlo di una nuova era di innovazione che potrebbe trasformare il nostro modo di pensare e lavorare. I prossimi anni saranno cruciali per il futuro di questo campo.